Interprétation, responsabilité et robustesse dans le machine learning

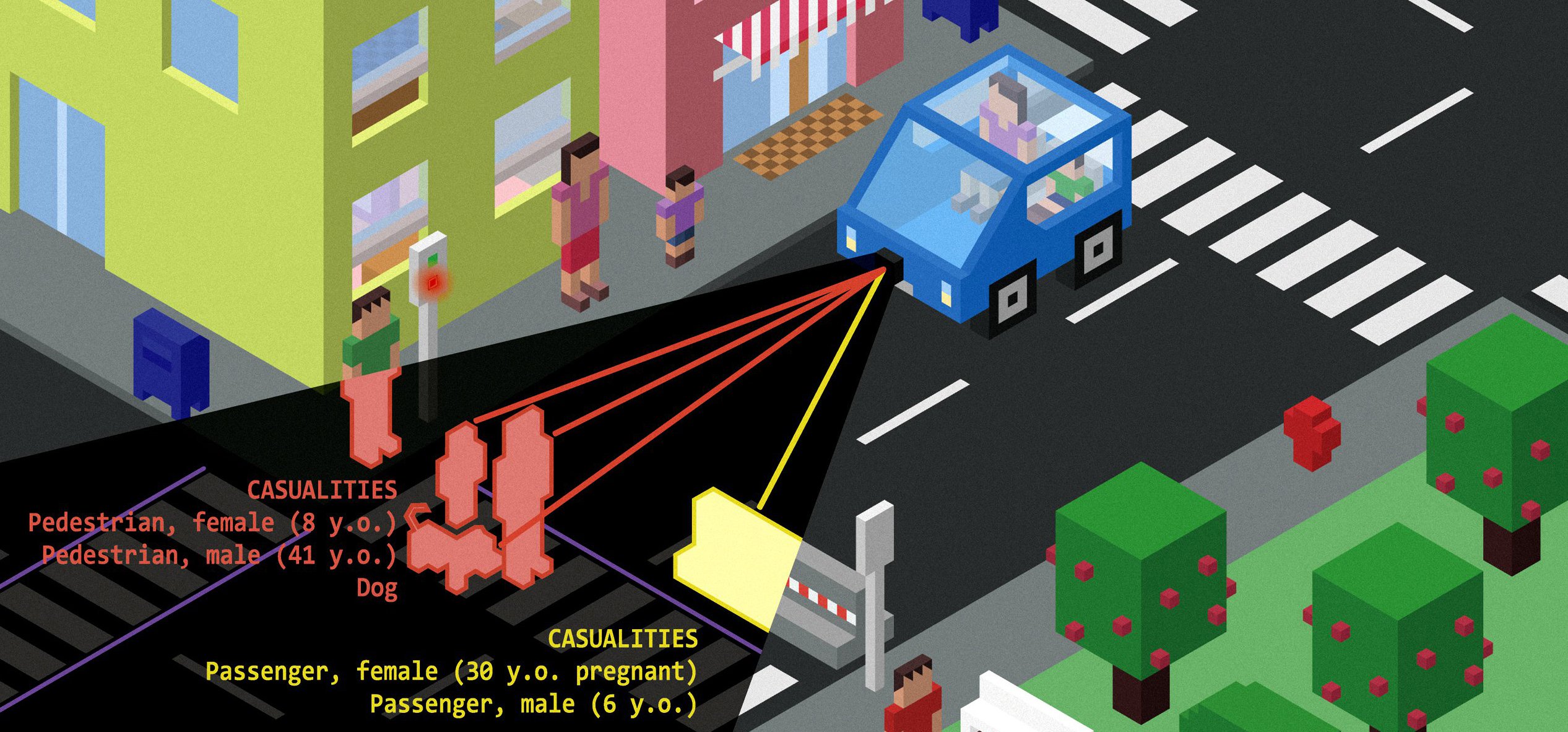

De nos jours, la science des données, le machine learning, les solutions basées sur l’intelligence artificielle intégrées dans les secteurs de l’industrie, de l’économie et de la santé, se trouvant dans les appareils qui nous entourent, font partie de nos vies. Et comme les décisions qu’ils prennent sont de plus en plus importantes pour nous, la question de leur interprétation et de l’explicabilité de leur comportement devient cruciale.

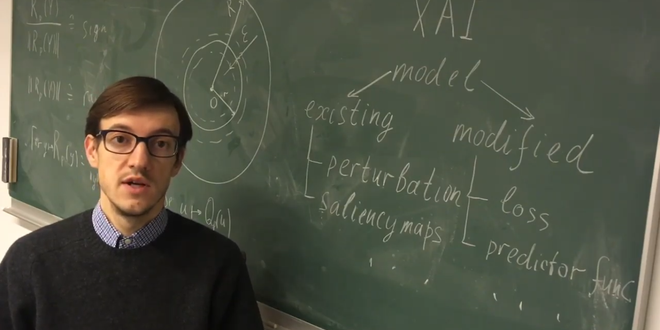

Il existe deux principaux types d’approches pour parvenir à l’explicabilité des algorithmes :

– les approches qui expliquent les décisions pour les modèles existants ;

– les approches qui modifient le modèle ou son processus de formation en incorporant la capacité d’expliquer.

Les méthodes du premier groupe sont en place lorsque l’algorithme d’IA est fixe et elles donnent des indications sur les raisons pour lesquelles certaines sorties ont été produites pour l’entrée donnée.

Les approches du deuxième groupe modifient la conception de l’algorithme pour produire des explications en même temps que les prédictions ou forcent l’algorithme à produire des solutions explicables.

Dans cette vidéo, Pavlo Mozharovskyi, professeur à Télécom Paris, Institut Polytechnique de Paris, expose les deux approches fondamentales de l’explicabilité de l’intelligence artificielle.

La version originale de cet article a été publiée sur le site de Télécom Paris.

Trackbacks (rétroliens) & Pingbacks

[…] Interprétation, responsabilité et robustesse dans le machine learning […]

[…] Interprétation, responsabilité et robustesse dans le machine learning […]

Laisser un commentaire

Rejoindre la discussion?N’hésitez pas à contribuer !