Les intelligences artificielles doivent dialoguer pour être efficaces

Dans tous les secteurs, l’automatisation des tâches de décision implique de plus en plus d’intelligences artificielles. Bien souvent, ces agents autonomes intelligents ne peuvent pas évoluer de manière isolée, et doivent collaborer avec leurs pairs. À Mines Saint-Étienne, le chercheur en intelligence artificielle Olivier Boissier travaille justement à assurer que cette collaboration se déroule de manière efficace, en facilitant la coordination et la coopération entre agents autonomes.

« Il n’y a pas une, mais plusieurs intelligences artificielles » affirme Olivier Boissier. Ce chercheur de Mines Saint-Étienne met en avant la diversité des agents autonomes développés par les humains pour accomplir des tâches spécifiques : « Une personne qui évolue dans un environnement n’est pas forcément la seule à utiliser un agent. Et les autres agents ne sont pas forcément mis au point par le même développeur. » D’où l’importance de réussir à les faire interagir ensemble.

Dans un tel contexte, le rôle du scientifique est de fixer un cadre de programmation des agents qui permettra aux intelligences artificielles (IA) de communiquer entre elles, de se comprendre. Cela passe par la définition de langages de communication et de modèles de coordination communs à chaque agent, puis d’algorithmes leur permettant de traiter des informations, des tâches venant des communications de leurs semblables.

L’action automatisée que chaque agent prendra en fonction des communications établies est en revanche définie par les utilisateurs ou les cas d’usage. « Nous pouvons être amenés à introduire des algorithmes génériques définissant des actions minimales de base, explique Olivier Boissier. Mais la connaissance métier qui servira à l’agent pour remplir son rôle est apportée par les experts humains du secteur dans lequel il sera utilisé. »

L’éthique des intelligences artificielles

Ce cadre permettant de fixer les interactions dépend grandement du contexte d’utilisation. Olivier Boissier est par exemple impliqué dans le projet Ethicaa financé par l’Agence nationale de la recherche (ANR), et qui réunit notamment Télécom École de Management et le laboratoire LIP6 de l’université Pierre et Marie Curie. Le but ? Assurer que dans un environnement donné, tous les agents autonomes adoptent un comportement éthique. « À la différence de la morale, qui définit ce qui est bon à partir de valeurs comme la justice, l’honnêteté, etc., l’éthique définit ce qui est juste entre les actions morales, souhaitables ou possibles dans un contexte fixé » détaille le chercheur.

Mais dans un système ouvert où les IA viennent de plusieurs sources, il y a potentiellement autant d’éthiques que d’agents. Olivier Boissier met donc au point des algorithmes permettant aux IA d’identifier mutuellement leurs comportements comme éthiques ou non. Surtout, chaque agent doit être capable de guider le comportement des autres pour éviter toute action hors limite. « À partir des différents jugements, les agents doivent être capables de bâtir des coalitions et de se comprendre pour définir une éthique collective qui convienne à chacun » synthétise le chercheur.

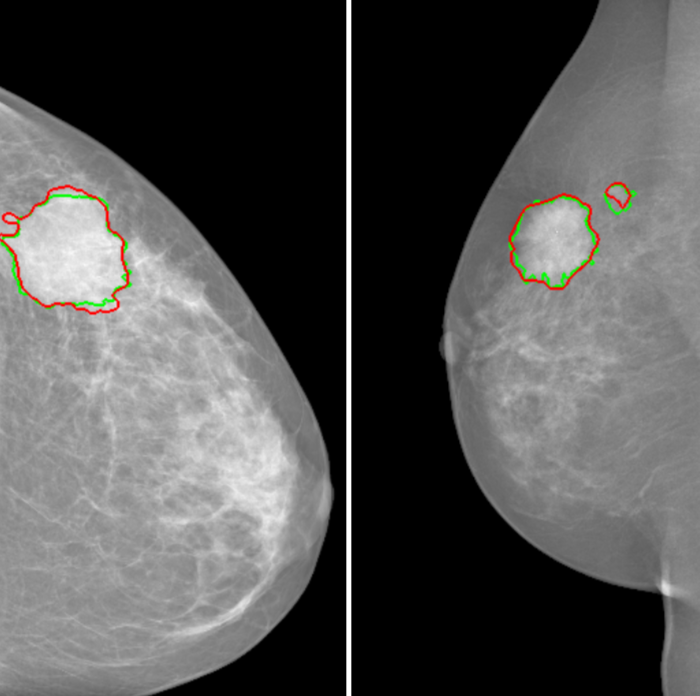

Le projet Ethicaa trouve de potentielles retombées dans le secteur de la santé. L’agent autonome pourrait tout à fait être un assistant personnel assurant la liaison entre un individu et son médecin. Dans la mesure où l’IA aurait accès à des données personnelles issues de l’historique des examens médicaux, ou des traceurs d’activités et autres objets connectés personnels, il lui faudra choisir de divulguer ou non les informations au corps médical. « L’agent devra-t-il privilégier la santé ou l’intimité ? » problématise Olivier Boissier. La réponse peut apparaître triviale si l’agent associe une activité cardiaque inhabituelle et à risque aux données relevées lors du dernier footing d’une personne. Elle l’est moins s’il s’agit de communiquer au médecin ou aux assurances médicales le contenu de son dernier repas.

Favoriser aussi la confrontation entre agents autonomes

Interaction ne signifie pas nécessairement coopération cependant. L’objectif d’Olivier Boissier est avant tout que chacune de ces intelligences artificielles prenne en compte les actions de ses semblables. En revanche, les cas d’utilisation des agents détermineront s’ils agiront pour favoriser une action commune — c’est le cas dans le projet Ethicaa— ou au contraire pour se mettre en compétition. « Dans le cas d’agents autonomes programmés pour effectuer des actions financières, chacun aura des intérêts divergents ; ils se feront donc concurrence » illustre-t-il.

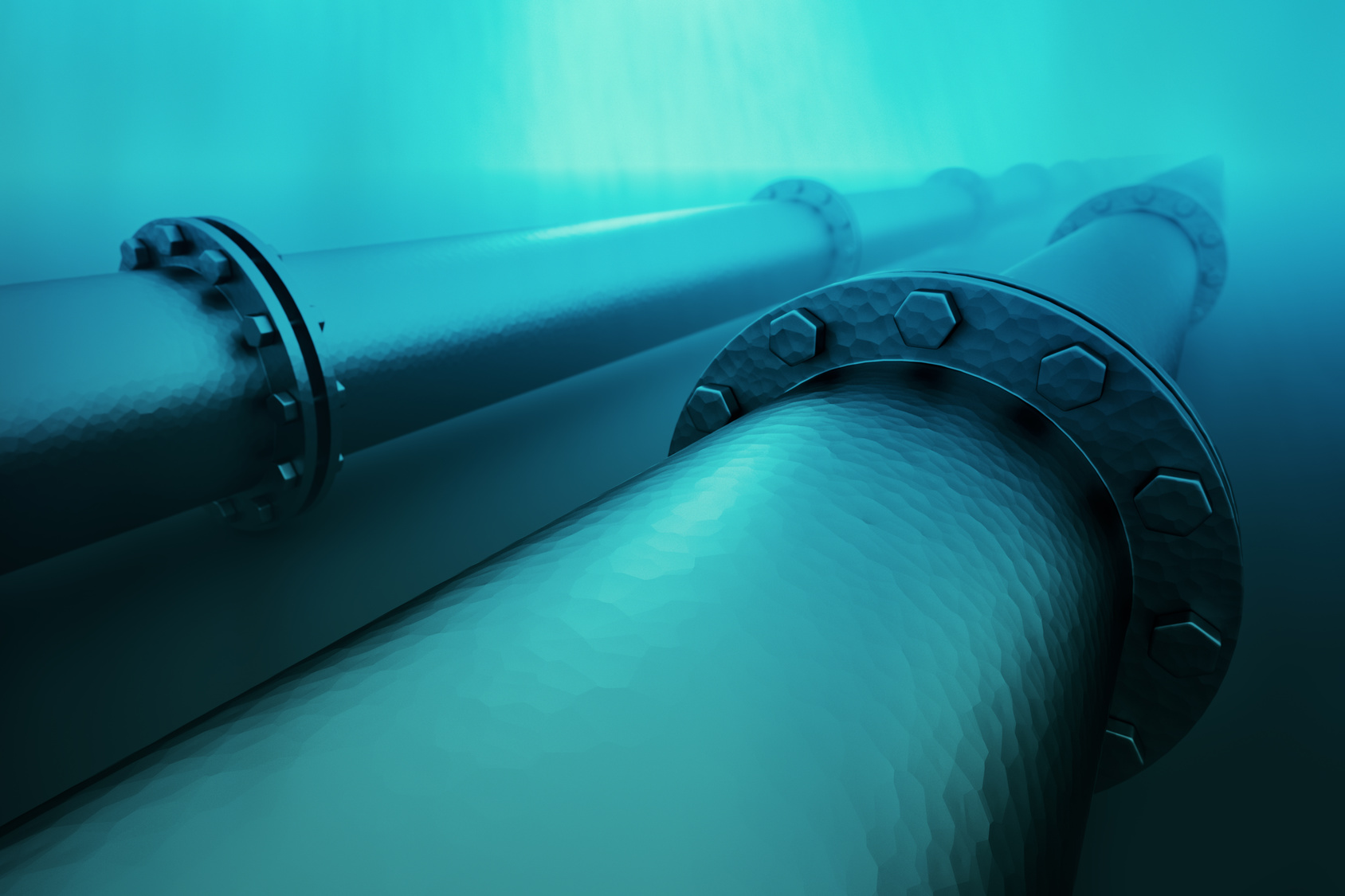

Et cela n’est pas vrai que pour les usages d’IA dans les places boursières. Olivier Boissier est également impliqué dans le projet SEAS, du programme européen ITEA. Dans ces travaux, les agents sont amenés à utiliser des données issues de bases publiques et/ou privées pour permettre à des individus de mieux gérer l’énergie de leur habitat. « Aujourd’hui, nous sommes consommateurs, mais nous pouvons aussi être producteurs ou stockeurs » remarque le chercheur. Dans ce contexte, il est possible de vendre de l’électricité à des moments où la demande est plus grande, et donc à plus forte valeur. Des actions qui peuvent être automatisées par des agents intelligents.

Là encore, l’environnement est décentralisé : chaque habitant utilise en effet un agent potentiellement différent. Et le niveau de complexité va même au delà de la diversité des fournisseurs. « Chaque agent peut être programmé en fonction des préférences de l’utilisateur » mentionne ainsi Olivier Boissier. Les logiques et les décisions des IA sont donc personnalisées, et l’enjeu est alors de permettre aux agents de trouver un accord lorsqu’ils sont en confrontation.

Si les IA permettent d’automatiser des tâches, cela ne supprime donc pas les négociations nécessaires et les intérêts conflictuels. S’assurer que la communication entre les agents est bien établie et qu’ils agissent en conscience de leur environnement est nécessaire pour que chacune de leurs actions soit efficace. En fin de compte, il s’agit de fluidifier et d’optimiser les organisations collectives. Avec peut-être à la clé des négociations qui aboutissent plus souvent à des consensus que lorsque des humains sont impliqués.

[divider style= »solid » top= »20″ bottom= »20″]

L’intelligence artificielle à l’Institut Mines-Télécom

Le 8e cahier de veille de la Fondation Télécom sorti en juin 2016 est dédié à l’intelligence artificielle (IA). Il dresse un état de l’art de la recherche dans le monde sur ce sujet, et présente les nombreux travaux existants au sein des écoles de l’Institut Mines-Télécom dans ce domaine. En 27 pages, ce cahier de veille définit ce qu’est l’intelligence (rationnelle, naturaliste, systémique, émotionnelle, kinesthésique…), visite l’histoire de l’IA, questionne les perspectives qui s’ouvrent et pose la question de son appropriation par l’humain.

Télécharger le cahier de veille

[divider style= »solid » top= »20″ bottom= »20″]

Trackbacks (rétroliens) & Pingbacks

[…] À lire sur le blog : Les IA doivent dialoguer pour être efficaces […]

[…] Les intelligences artificielles doivent dialoguer pour être efficaces […]

Laisser un commentaire

Rejoindre la discussion?N’hésitez pas à contribuer !