La centrale nucléaire américaine « Three Mile Island » est tristement célèbre pour avoir été le théâtre de l’un des plus terribles accidents nucléaires de l’histoire en 1979, et elle va bientôt reprendre du service pour alimenter les systèmes d’intelligence artificielle (IA) de Microsoft. Cette annonce, faite en septembre 2024 et qui concerne un réacteur indépendant de celui ayant causé l’accident de 1979, s’inscrit dans une tendance plus globale d’investissements massifs des géants du numérique dans l’énergie nucléaire.Ainsi, Google a également annoncé la signature d’un accord avec la start-up Kairos Energy, spécialisée dans la construction de petits réacteurs nucléaires modulaires (dits « SMR »), pour financer son développement et réserver une partie de sa capacité de production à l’horizon 2030. Amazon, suivant le mouvement, a conclu un partenariat similaire avec la start-up X-energy.

La raison de ces investissements est simple : le développement exponentiel de l’IA générative demande d’importantes capacités de calcul, localisées dans des centres de données particulièrement énergivores.

Les études les plus récentes montrent que l’IA représente entre 10 et 20 % de l’électricité consommée par l’ensemble des centres de données dans le monde, laquelle augmente de 20 à 40 % chaque année d’après l’Agence Internationale de l’Énergie (AIE). Dans certains pays, comme l’Irlande, la consommation liée aux centres de données a même dépassé la quantité d’électricité consommée par les ménages.

La démesure de ces chiffres interroge, qui plus est dans un contexte où l’urgence climatique est dans tous les esprits et alors qu’on demande aux citoyens de limiter leur chauffage à 19 °C, cette course à la capacité de calcul est-elle vraiment soutenable et souhaitable ? Doit-on réellement chercher par tout moyen à construire de nouvelles capacités de production d’électricité pour suivre le rythme de développement des centres de données ?

Les solutions à cette crise ne sont pas évidentes tant il y a d’intérêts divergents et de facteurs à prendre en considération. Pourtant, des pistes pour limiter la consommation énergétique de l’IA et l’explosion du nombre de centres de données, telles que la fiscalité ou la régulation, commencent à émerger dans les discussions internationales.

Pourquoi l’IA a-t-elle besoin de tant d’énergie ?

Chaque fois que nous posons une question à notre système d’IA générative préféré, la demande est envoyée par Internet pour être traitée dans un centre de données qui peut être situé dans différentes régions du monde. Ce dernier consomme de l’électricité pour alimenter les composants informatiques qu’il héberge et son système de refroidissement, sans compter l’énergie requise pour construire le centre et les composants électroniques eux-mêmes.

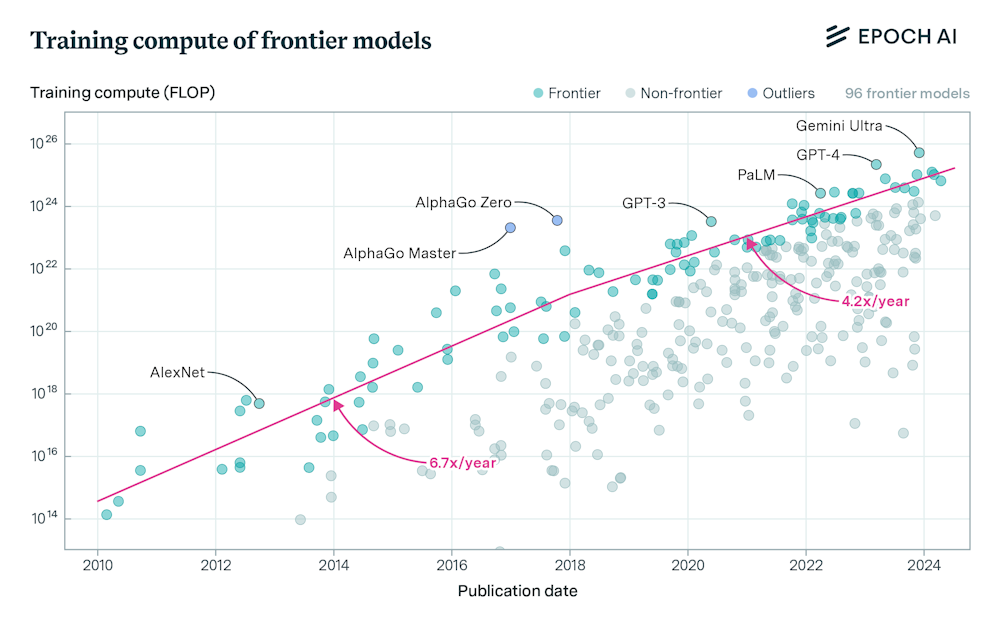

Ces dernières années, les principaux modèles d’IA ont gagné en complexité et requièrent des capacités de calcul toujours plus importantes pour fonctionner, de 4 à 5 fois plus chaque année depuis 2010 d’après les études les plus récentes. En parallèle, le nombre d’utilisateurs ne cesse d’augmenter, avec plus de 200 millions d’utilisateurs chaque semaine rien que sur ChatGPT.